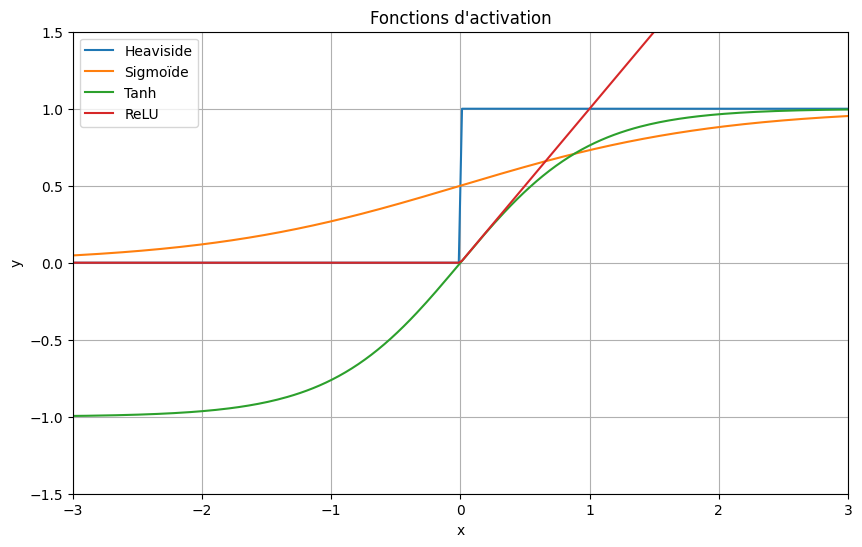

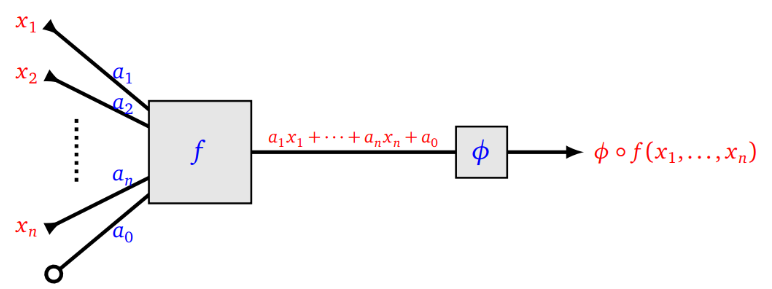

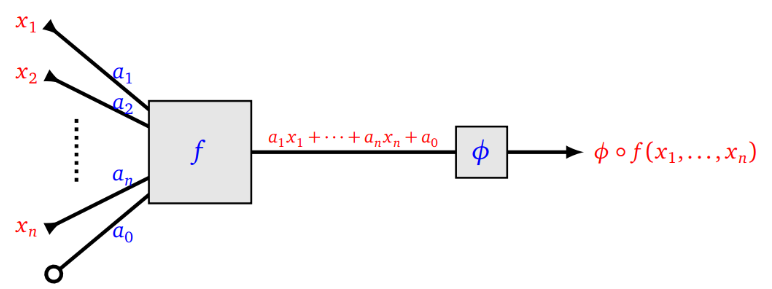

Modélisation matématique d'un neurone ou perceptron : x_i les entrées, a_i les poids, f une fonction linéaire, et \phi la fonction d'activation.

Modélisation matématique d'un neurone ou perceptron : x_i les entrées, a_i les poids, f une fonction linéaire, et \phi la fonction d'activation.